Multimodal Dialogue Response Generation

0. 简介

本文发表于ACL2022,提出了一个新的多模态对话回复生任务成,即对于给定的对话上下文,模型需要生成一个文本或图像作为回复。学习这样的模型通常需要包含文本和图像的多模态对话,而这是很难获得的。在这种低资源环境下,作者设计了一个新的对话模型Divter。它可以从整个生成模型中分离出依赖于多模态对话的参数。通过这种方式,模型的主要部分可以分别从大量的纯文本对话和文本-图像对中学习,然后只需使用少数训练实例就可以很好地拟合整个参数。大量的实验表明,该方法在自动和人工评估中都取得了最先进的结果,并能生成信息丰富的文本和高分辨率的图像回复。

1. 前言

近年来,开放域对话生成系统越来越受欢迎,而之前的工作大多都集中于纯文本的单模态对话上。近年来随着多模态技术的发展,出现了越来越多基于感知的多模态对话任务,最为常见的就是基于图像的对话生成任务。在人类的对话中,图像可以很容易地表现出丰富的视觉感受,而这是很难用纯文本表达的。

由于复杂的端到端神经网络架构在极少数注释良好的训练数据(例如,现有的一些10k多模态对话)上过拟合。证据是,当讨论训练数据领域之外的话题时,其性能会急剧下降。而且由于人力成本很高,为一个新领域收集足够的训练数据并不容易。

2. 模型

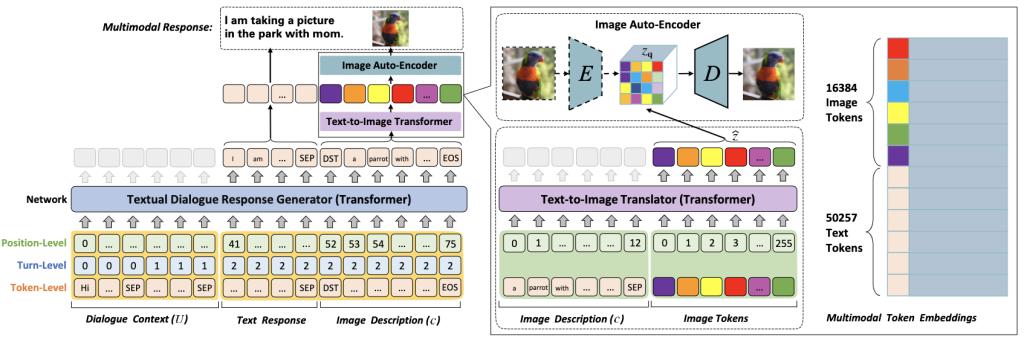

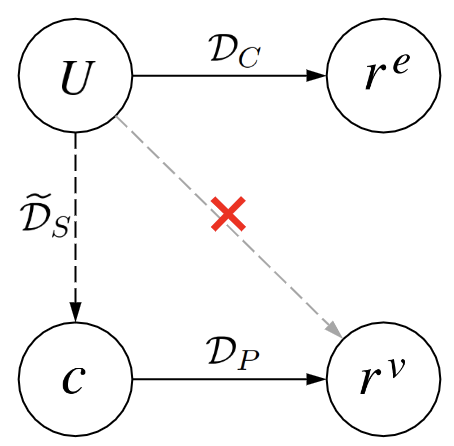

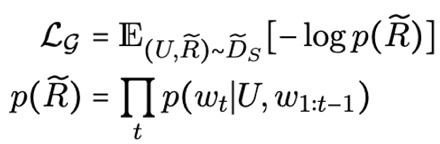

针对上述问题,作者的关键想法是通过拆分文本回复生成和图像回复生成,使依赖多模态对话的参数变得小而独立,因此可以从纯文本对话和<图像描述,图像>对中学习生成模型的主要部分,而这是更容易得到的。作者因此提出了一个新的模型Divter,它主要由两部分组成:纯文本对话回复生成器和文本到图像的转换器。其总体结构如下图所示:

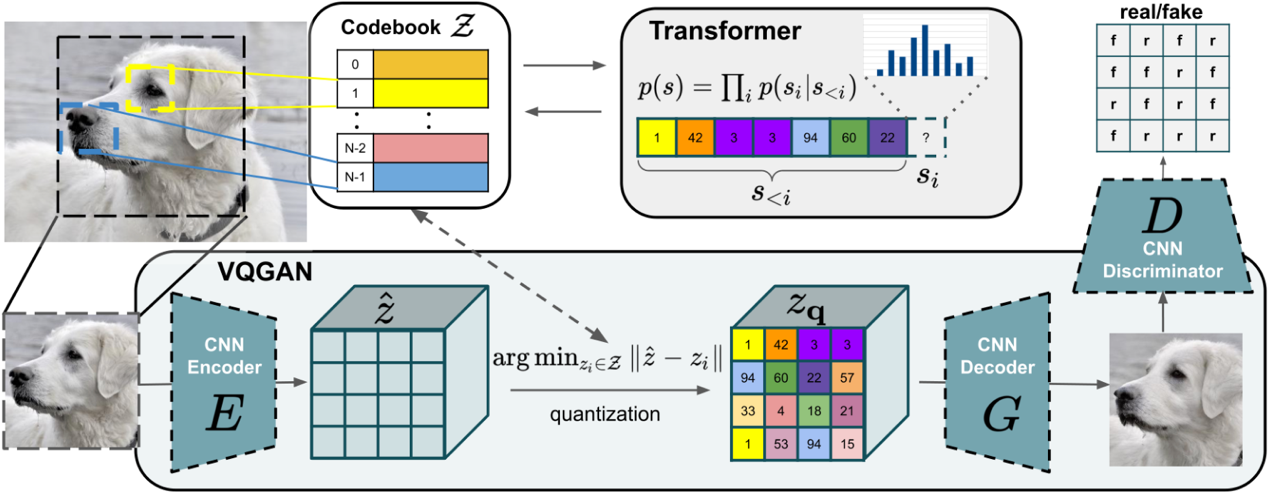

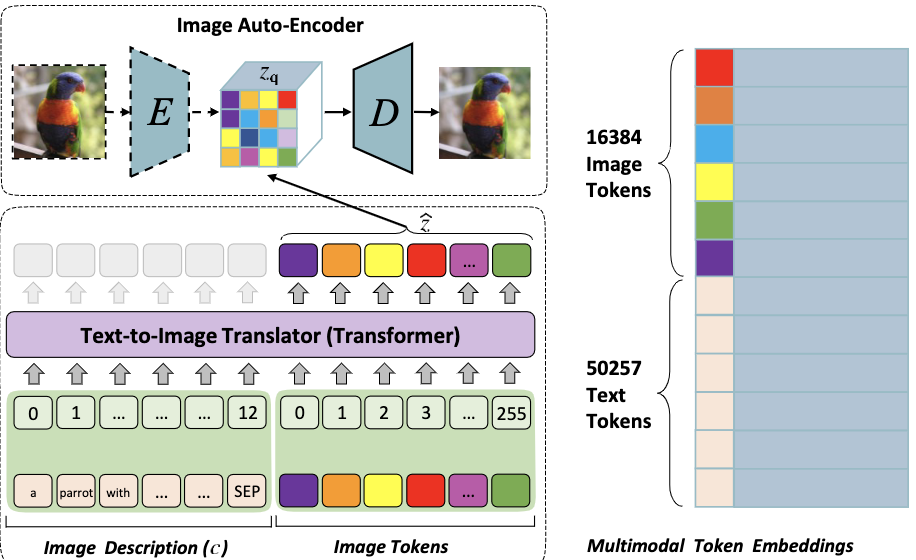

2.1 多模态标记

要学习多模态生成模型,我们首先要对文本和图像的统一表示进行建模。针对于文本,该文使用了BPE方法进行标记化。针对于图像作者使用了VQGAN进行标记化。如下图所示:

2.2 低资源学习模型

用一个单一的序列到序列的模型来学习一个有效的多模态生成模型往往需要大量的训练实例。然而,由于社交媒体的隐私限制和昂贵的人力成本,只有极少数的多模态对话是可用的。

基于上述事实和MDRG任务的低资源挑战,我们将生成性文本-图像翻译纳入纯文本的开放域对话响应生成。 具体来说:(1)如果多模态对话语境包含图像,我们用其描述替换图像,形成一个纯文本语境,并将此语境作为纯文本对话生成模型的输入;(2)如果我们需要生成图像作为回应的一部分,我们可以先用G生成一个文本描述,然后采用文本-图像翻译模块将描述转换为一个同义的图像。(1)和(2)的动作都可以独立学习。 有了预先训练好的两个模型,我们最后使用少量标注数据来共同微调以上两个模型,以获得生成多模态回复的能力。 具体步骤如下图所示:

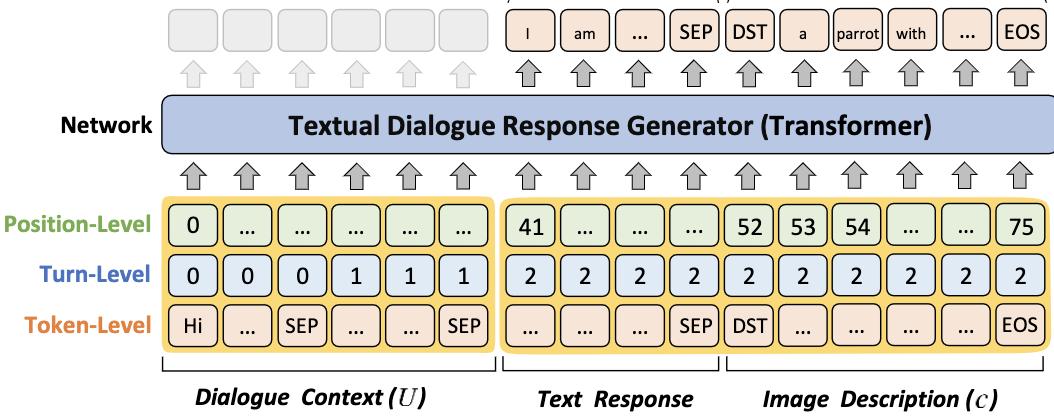

2.3 文本对话生成器

文本对话回复生成器的具体结构如下图所示:

其模型结构和GPT2一样,输入为对话历史内容

输出为回复内容和图像的文本描述

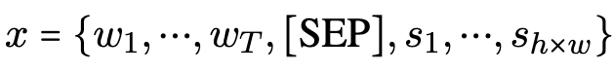

损失函数为:

2.4 文本-图像转换器

文本-图像转换器的具体结构如下图所示:

其模型结构和文本对话回复生成器一样,其中图像的标记可定义为:

模型的输入为图像的文本描述:

模型的输出为图像的标记,损失函数为:

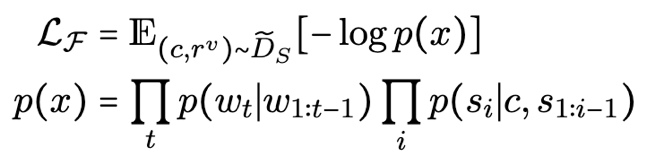

3. 实验

本文使用Reddit对话数据集预训练文本对话回复生成器,使YFCC100M and ImageNet数据集来预训练文本-图像转换器。模型PhotoChat数据集上的结果如下。

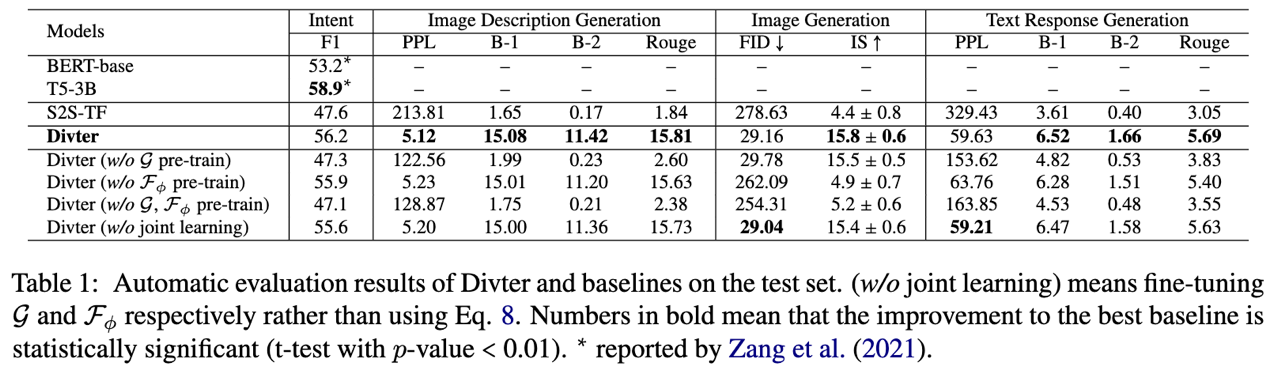

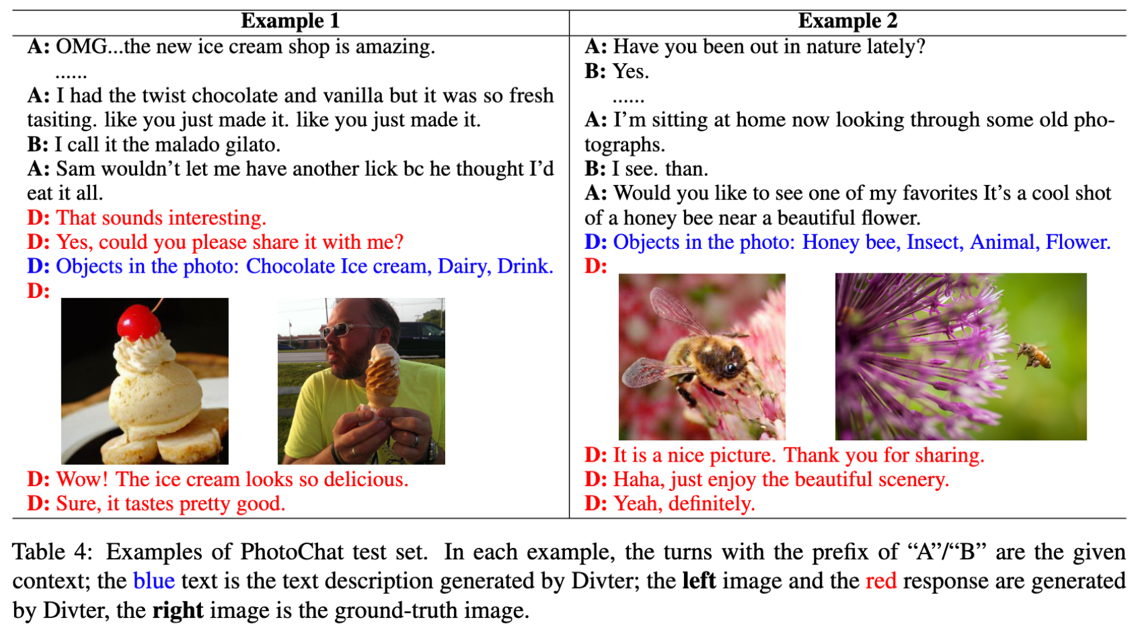

此外作者作了一些可视化实验。

4. 总结

作者探索了在低资源环境下的多模态对话回复生成。为了克服来自新任务和训练数据不足的挑战,该工作提出了Divter,一个将文本到图像生成纳入纯文本对话响应生成的神经对话模型,其中大多数参数不再依赖训练数据。